какую работу выполняют роботы пауки поисковых машин

Роботы поисковой системы

Роботы поисковой системы, иногда их называют «пауки» или «кроулеры» (crawler) — это программные модули, занимающиеся поиском web-страниц. Как они работают? Что же они делают в действительности? Почему они важны?

Учитывая весь шум вокруг поисковой оптимизации и индексных баз данных поисковиков, вы, наверное думаете, что роботы должно быть великие и могущественные существа. Неправда. Роботы поисковика обладают лишь базовыми функциями, похожими на те, которыми обладали одни из первых броузеров, в отношении того, какую информацию они могут распознать на сайте. Как и ранние броузеры, роботы попросту не могут делать определенные вещи. Роботы не понимают фреймов, Flash анимаций, изображений или JavaScript. Они не могут зайти в разделы, защищенные паролем и не могут нажимать на все те кнопочки, которые есть на сайте. Они могут «заткнуться» в процессе индексирования динамических адресов URL и работать очень медленно, вплоть до остановки и безсилием над JavaScript-навигацией.

Как работают роботы поисковой машины?

Поисковые роботы стоит воспринимать, как программы автоматизированного получения данных, путешествующие по сети в поисках информации и ссылок на информацию.

Когда, зайдя на страницу «Submit a URL», вы регистрируете очередную web-страницу в поисковике — в очередь для просмотра сайтов роботом добавляется новый URL. Даже если вы не регистрируете страницу, множество роботов найдет ваш сайт, поскольку существуют ссылки из других сайтов, ссылающиеся на ваш. Вот одна из причин, почему важно строить ссылочную популярность и размещать ссылки на других тематических ресурсах.

Прийдя на ваш сайт, роботы сначала проверяют, есть ли файл robots.txt. Этот файл сообщает роботам, какие разделы вашего сайта не подлежат индексации. Обычно это могут быть директории, содержащие файлы, которыми робот не интересуется или ему не следовало бы знать.

Роботы хранят и собирают ссылки с каждой страницы, которую они посещают, а позже проходят по этим ссылкам на другие страницы. Вся всемирная сеть построена из ссылок. Начальная идея создания Интернет сети была в том, что бы была возможность перемещаться по ссылкам от одного места к другому. Вот так перемещаются и роботы.

«Остроумность» в отношении индексирования страниц в реальном режиме времени зависит от инженеров поисковых машин, которые изобрели методы, используемые для оценки информации, получаемой роботами поисковика. Будучи внедрена в базу данных поисковой машины, информация доступна пользователям, которые осуществляют поиск. Когда пользователь поисковой машины вводит поисковый запрос, производится ряд быстрых вычислений для уверенности в том, что выдается действительно правильный набор сайтов для наиболее релевантного ответа.

Вы можете просмотреть, какие страницы вашего сайта уже посетил поисковый робот, руководствуясь лог-файлами сервера, или результатами статистической обработки лог-файла. Идентифицируя роботов, вы увидите, когда они посетили ваш сайт, какие страницы и как часто. Некоторые роботы легко идентифицируются по своим именам, как Google’s «Googlebot». Другие более скрытые, как, например, Inktomi’s «Slurp». Другие роботы так же могут встречаться в логах и не исключено, что вы не сможете сразу их идентифицировать; некоторые из них могут даже оказаться броузерами, которыми управляют люди.

Помимо идентификации уникальных поисковых роботов и подсчета количества их визитов, статистика также может показать вам агрессивных, поглощающих ширину катала пропускания роботов или роботов, нежелательных для посещения вашего сайта.

Как они читают страницы вашего web-сайта?

Когда поисковой робот посещает страницу, он просматривает ее видимый текст, содержание различных тегов в исходном коде вашей страницы (title tag, meta tags, и т.д.), а так же гиперссылки на странице. Судя по словам ссылок, поисковая машина решает, о чем страница. Есть много факторов, используемых для вычисления ключевых моментов страницы «играющих роль». Каждая поисковая машина имеет свой собственный алгоритм для оценки и обработки информации. В зависимости от того, как робот настроен, информация индексируется, а затем доставляется в базу данных поисковой системы.

После этого, информация, доставленная в индексные базы данных поисковой системы, становится частью поисковика и процесса ранжирования в базе. Когда посетитель существляет запрос, поисковик просматривает всю базу данных для выдачи конечного списка, релевантного поисковому запросу.

Базы данных поисковых систем подвергаются тщательной обработке и приведению в соответствие. Если вы уже попали в базу данных, роботы будут навещать вас периодически для сбора любых изменений на страницах и уверенности в том, что обладают самой последней информацией. Количество посещений зависит от установок поисковой машины, которые могут варьироваться от ее вида и назначения.

Иногда поисковые роботы не в состоянии проиндексировать web-сайт. Если ваш сайт упал или на сайт идет большое количество посетителей, робот может быть безсилен в попытках его индексации. Когда такое происходит, сайт не может быть переиндексирован, что зависит от частоты его посещения роботом. В большинстве случаев, роботы, которые не смогли достичь ваших страниц, попытаются позже, в надежде на то, что ваш сайт в ближайшее время будет доступен.

Многие поисковые роботы не могут быть идентифицированы, когда вы просматриваете логи. Они могут посещать вас, но логи утверждают, что кто-то использует Microsoft броузер и т.д. Некоторые роботы идентифицируют себя использованием имени поисковика (googlebot) или его клона (Scooter = AltaVista).

В зависимости от того, как робот настроен, информация индексируется, а затем доставляется в базы данных поисковой машины.

Базы данных поисковых машин подвергаются модификации в различные сроки. Даже директории, имеющие вторичные поисковые результаты используют данные роботов как содержание своего web-сайта.

Собственно, роботы не используются поисковиками лишь для вышеизложенного. Существуют роботы, которые проверяют баз данных на наличие нового содержания, навещают старое содержимое базы, проверяют, не изменились ли ссылки, загружают целые сайты для просмотра и так далее.

По этой причине, чтение лог-файлов и слежение за выдачей поисковой системы помогает вам наблюдать за индексацией ваших проектов.

Краулеры (поисковые роботы): зачем нужны, виды, как управлять и анализировать?

Краулер (поисковый бот, робот, паук) – это неотъемлемая для поисковой системы программа, отвечающая за поиск сайтов и сканирование их содержимого путем перехода по страницам и ссылкам для занесения собранной информации в базу данных поисковика.

Зачем нужны поисковые пауки?

Допустим, есть пользователь Иван Иванов, ежедневно посещающий какой-нибудь популярный книжный онлайн-ресурс, и этот ресурс регулярно пополняется новыми произведениями. Переходя на сайт, Иван осуществляет следующую последовательность действий:

Чтобы найти подходящий материал, Иванову пришлось потратить около 10 минут. Если каждый день уделять 10 минут на поиск нужной книги, в месяц на этой уйдет в общем 5 часов. И это касается только одного сайта.

Во избежание таких временных затрат нужно использовать программу, в автоматическом режиме занимающуюся поиском новинок.

Без роботов ни один поисковик не будет эффективным, вне зависимости от того, Google это или новая поисковая система. И чтобы не делать, как Иван, они используют роботов для «обхода» сайтов, отыскивающих для поисковых систем новую информацию, которую они смогут предложить пользователям. И чем лучше сканирует краулер, тем актуальнее материалы в выдаче.

Основные боты выполняют следующие функции:

И много других различных краулеров, которые имеют свое предназначение, о которых мы поговорим ниже.

Виды краулеров

У каждого поисковика есть набор собственных веб-пауков, выполняющих различные функции. Поговорим о ботах двух популярнейших поисковых машин.

Роботы Яндекса

Боты Google

Другие поисковые роботы

Краулеры есть не только у поисковых систем. Так, у популярной соцсети Facebook роботы собирают коды страниц, которые

репостят пользователи, чтобы показывать ссылки с заголовками, описанием и картинкой. Рассмотрим более детально веб-пауков, не относящихся к Google и Яндексу.

Ahrefs

Самый популярный инструмент для SEO-продвижения, который помогает анализировать ссылочную массу. Что делает:

Благодаря нему специалисты в области цифрового маркетинга могут проанализировать своих конкурентов и подобрать наиболее эффективную тактику продвижения сайта.

SEMrush

Еще один отличный сервис для оптимизации сайтов, который больше заточен на зарубежный интернет и Google. Он решает такие задачи:

SEO Spider

Программа для сканирования данных на маленьких и крупных ресурсах. Способна:

Spider работает на оперативных системах Windows, MacOS и Ubuntu. В бесплатной версии можно анализировать до 500 страниц.

Serpstat

Комплексный краулер для развития SEO, рекламного контента и улучшения показателей PPC. Он изучает:

Еще здесь есть функция определения ключевых слов, сравнения доменов, анализ контента и так далее.

Часто используемый SEO инструмент за рубежом для проверки и оптимизации веб-ресурса.

И это далеко не полный список. Приведены только самые популярные краулеры.

Как управлять поисковым роботом?

Очень часто приходится ограничивать доступ некоторым краулерам к определенным страницам сайта. Для этого существуют специальные правила, которые вебмастера прописывают для пауков, чтобы они их придерживались. Указываются они в файле robots.txt.

Попадая на сайт, роботы сначала сканируют информацию в файле со списком документов, запрещенных для индексации, например, личные данные зарегистрированных пользователей. Ознакомившись с правилами, краулер или уходит с сайта, или начинает индексировать ресурс.

Что прописывать в файле robots:

Команды можно адресовать как всем ботам сразу, так и каждому по-отдельности.

Если мы откроем файл robots поисковой системы Яндекс, то увидим:

Определим, что все это значит:

Как узнать что робот заходил на сайт?

Есть несколько способов вычислить, что краулер посещал сайт и какие именно страницы. Все зависит от того, чей это бот.

Поисковый робот Яндекса

Основной паук поисковика, индексирующий контент, посещает страницы веб-ресурсов и отсылает их в базу данных с завидной регулярностью. Но он может найти не все необходимые страницы сайта, если они например недоступны.

В Яндекс.Вебмастере вы можете с легкостью узнать, какие именно страницы обошел бот, чтобы отыскать URL недоступных для него документов по причине перебоев на сервере или неправильного содержимого непосредственно страниц.

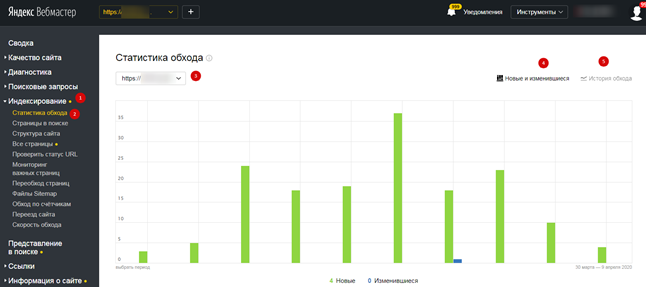

Зайдите в панели управления Вебмастера на страницу Индексирование, а затем – Статистика обхода. Обновление данных проводится ежедневно, максимум через 6 часов с той поры, когда робот зашел на страницу.

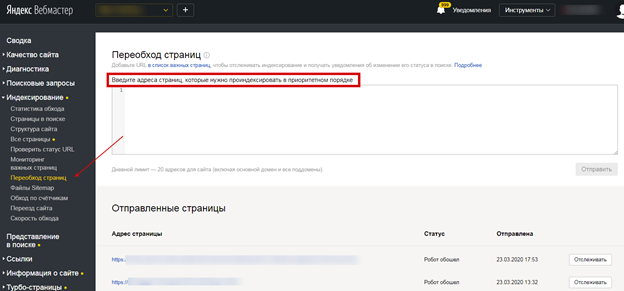

Изначально на сервисе вы увидите информацию по всему ресурсу. Если же вам нужна информация по определенному разделу, кликните на него в списке, расположенного в поле с указанным адресом сайта. Разделы выстроены в соответствии со структурой ресурса. Если вы не нашли в списке нужную страницу, сообщите о них поисковику через Переобход страниц.

Другие роботы

Еще один отличный способ вычислить, что поисковый паук посещал сайт – заглянуть в логи сервера.

В них хранится вся информация касательно того, кто посещал ресурс, когда и по каким страницам переходил, какой у него IP-адрес, какой ответ получил на сайте и прочее. Читать логи вручную довольно трудно, поэтому есть специальные программы, помогающие анализировать и читать логи в удобном формате, что очень важно, потому что с их помощью вы видите любое посещение роботом и человеком.

Одним из самых популярных инструментов, используемых с данной целью, является Screaming Frog SEO Log File Analyser. Отметим, что программа платная. Лицензия стоит 100$ в год. Есть и бесплатная версия с ограниченным функционалом:

Пользоваться программой просто. Для начала потребуется найти файлы access.log на сервере и загрузить их на компьютер с помощью FTP. В большинстве случаев они располагаются в папке /access_logs/ или просто /logs/. Если вы хотите детально проанализировать историю посещений, скачайте логи за период не менее месяца. Скачав файлы, кликните по Import и выберите пункт Log file.

Затем, как данные загрузятся, укажите любое название проекта и укажите часовой пояс. Далее отобразится главное окно админки, где показывается подробная информация: какие краулеры посещали ресурс, с какой частотой, сколько страниц просматривали и так далее.

Но можно «копнуть» еще глубже. К примеру, узнать, какие УРЛы загружаются медленно, а с каких часто приходят на сайт. Помимо этого показывается информация о кодах ответов, отдаваемых ссылками. В меню Response Codes есть фильтр для группирования адресов по типу кода. Так вы очень быстро отыщите ошибки.

Кстати, если нажать правой кнопкой на ссылку, то можно:

Особенно удобные функции перехода в файл robots и проверки индексирования.

Заключение

Без краулеров не существовало бы и поисковиков, ведь именно они сканируют сайты, собирают в них информацию и отправляют ее в базу данных, чтобы затем система включила ее в свой поиск и предоставила пользователям.

Поисковые боты нужны не только поисковикам, но и самим вебмастерам, чтобы успешно анализировать ресурсы, исправлять слабые места и успешно их раскручивать для поднятия на верхние позиции результатов выдачи.

Оцените эту статью. Чтобы мы могли делать лучший контент! Напишите в комментариях, что вам понравилось и не понравилось!

Рейтинг статьи: 4.6 / 5. Кол-во оценок: 7

Пока нет голосов! Будьте первым, кто оценит эту статью.

Поисковой паук (краулер): виды и функции

Поисковый паук (другие наименования — робот, веб-паук, краулер) — программа поисковой системы, сканирующая веб-ресурсы для отражения сведений о них в базе данных.

С какой целью создают поисковых пауков?

Приведём элементарный пример. Представим себе Иванова Валерия, который регулярно посещает сайт http://it-ebooks.info/, где ежедневно публикуются новые электронные книги. Заходя на ресурс, Валерий выполняет заданную последовательность действий:

1) открывает главную страницу;

2) заходит в раздел «Последние загруженные произведения»;

3) оценивает новинки из списка;

4) при появлении интересных заголовков, проходит по ссылкам;

5) читает аннотацию и, если она интересна, скачивает файл.

Указанные действия отнимают у Валерия 10 минут. Однако, если тратить на поиск 10 минут в день, в месяц это уже 5 часов. Вместо этого к задаче можно привлечь программу, отслеживающую новинки по расписанию. По механизму действия она будет представлять собой простейшего веб-паука, заточенного под выполнение определенных функций. Без краулеров не выживет никакая поисковая система, будь то лидеры Google и «Яндекс» или предприимчивые стартапы. Боты перемещаются по сайтам, отыскивая сырье для поисковой системы. При этом чем с большей отдачей трудится паук, тем актуальнее результаты выдачи (рис. 1).

В зависимости от поисковой системы, функции, которые мы перечислим ниже, могут выполнять один или несколько роботов.

1. Сканирование контента сайта. Функция краулера первого порядка — обнаружение вновь созданных страниц и сбор размещенной текстовой информации.

2. Считывание графики. Если поисковая система подразумевает поиск графических файлов, для этой цели может быть введен отдельный веб-паук.

3. Сканирование зеркал. Робот находит идентичные по содержанию, но разные по адресу, ресурсы. «Работник», наделенный такими должностными полномочиями, есть у «Яндекса».

Содержание

Виды поисковый роботов

У поисковых систем есть несколько пауков, каждый из которых поддерживает выполнение запрограммированных функций (рис. 2).

Пауки «Яндекс»

Пауки Google

Вежливые пауки — как научить роботов правилам поведения

Вежливыми называют краулеров, которые действуют, придерживаясь существующих правил поведения на сайте. Эти правила пишут вебмастеры, размещая их в файле robots.txt (рис. 3). Пауки, которые попадают на сайт, на начальном этапе изучают информацию в указанном файле, где перечислены страницы, содержание которых не подлежит разглашению (регистрационные данные пользователей, административные сведения). Получив указания, паук приступает к индексации сайта, либо покидает его.

В robots.txt прописывают:

User-Agent: Twitterbot Allow: /images

Расшифруем эти данные:

Вежливый робот всегда представляется и указывает в заголовке запроса реквизиты, которые дают возможность вебмастеру связаться с владельцем. Для чего вводятся ограничения? Владельцы ресурсов заинтересованы в привлечении реальных пользователей и не желают, чтобы программы строили на их контенте свой бизнес. Для этих целей сайты часто настраивают на обслуживание браузерных HTTP-запросов и лишь за тем — запросов от программ.

Какую работу выполняют роботы-пауки поисковиков

Краулер (поисковый робот, бот, паук) — это программные модули поисковых систем, которые отвечают за поиск веб-сайтов их сканирование и добавление материалов в базу данных.

Поисковый паук без участия оператора посещает миллионы сайтов с гигабайтами текстов. Их принцип действия напоминает работу браузеров: на первом этапе оценивается содержимое документа, затем материал сохраняется в базе поисковика, после чего он переходит по линкам в другие разделы.

Какую работу выполняют роботы пауки поисковых машин

Малознакомые с принципом работы поисковых ботов вебмастера представляют их какими-то могущественными существами. Но, все гораздо проще. Каждый робот отвечает за выполнение своих функций.

Они не могут проникать как «шпионы» в запароленные разделы сайта, понимать работу фреймов, JavaScript или флеш-анимаций. Все зависит от того, какие функции в них были заложены разработчиками.

Поисковая выдача формируется в 3 этапа:

Специалисты Google и «Яндекс» часто вносят коррективы в работу поисковых роботов, например, ограничивают объем сканируемого текста или глубину проникновение паука внутрь сайта. Вебмастерам приходится адаптироваться под изменения при SEO-продвижении: выбирать оптимальные размеры текстов, ориентируясь на конкурентов в ТОП-10 выдаче, учитывать вложенность материалов, производить перелинковку материалов и так далее.

У каждой поисковой системы, будь то Google или «Яндекс», есть свои «пауки», отвечающие за разные функции. Их количество отличается, но задачи практически идентичные.

Как управлять поисковыми ботами?

Часто владельцы сайтов закрывают доступ некоторым поисковым роботам к определенному содержимому сайта, которое не должно принимать участие в поиске. Все команды паукам прописываются в специальном файле robots.txt.

Документ предоставляет краулерам список документов, которые нельзя индексировать (это может быть технические разделы сайта или личные данные пользователей). Ознакомившись с правилами, робот уходит с сайта или переходит на разрешенные для сканирования страницы.

Что указывать в robots.txt:

Команды могут быть общими для всех роботов или отдельные для Yandex, Googlebot, Mail.Ru. Подробнее о работе с robots.txt читайте здесь.

Как узнать, что поисковый робот посещает сайт?

Существует несколько способов, позволяющих определить, как часто на ваш сайт заходят краулеры. Проще всего это отследить робота от «Яндекса». Для этого авторизуйтесь в сервисе «Яндекс.Вебмастер», откройте страницу «Индексирование» и «Статистика обхода»:

В этом разделе вы узнаете, какие страницы обошел робот, как часто обращался к вашему сайту («История обхода») и ошибки, случившиеся по причине перебоев со стороны сервера или неправильного содержимого документов.

Чтобы получить подробную информацию по конкретному разделу, найдите его в списке, где указан URL-сайта.

Рассказать поисковому роботу и направить на конкретную страницу можно с помощью инструмента «Переобход страниц». Добавьте урл-адреса в соответствующее поле:

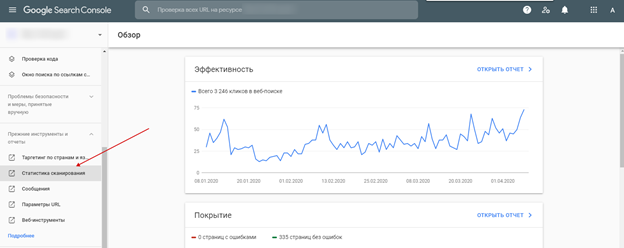

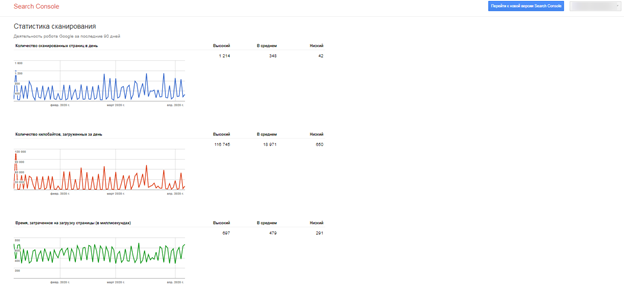

Точно также успешно можно отследить и посещение поискового робота Google. Для этого авторизуйтесь в Google Analytics.

Появятся данные про обход страниц роботом:

Выводы

Краулеры нужны не только поисковым системам для индексирования сайтов и добавления документов в базу данных, но и для SEO-специалистов, чтобы анализировать ресурсы, исправлять недочеты и успешно продвигать их в поиске.

Вебмастера будут всегда пытаться разгадать алгоритмы работы поисковых роботов, которые постоянно совершенствуются. Работа над качеством сайта — долгий и тернистый путь, направленный на долгосрочный результат.

А у вас не было проблем с индексацией сайта? Отслеживаете ли вы посещение сайта поисковыми роботами? Поделитесь свои опытом в комментариях.

Сайт с нуля

Создание сайта. Продвижение сайта. Заработок на сайте.

Что такое поисковые роботы?

Поисковые роботы, иногда их называют «пауки» или «кроулеры» (crawler) — это программные модули, занимающиеся поиском web-страниц. Как они работают? Что же они делают в действительности? Почему они важны?

Эти специальные программы, на самом деле, обладают лишь базовыми функциями, похожими на те, которыми обладали одни из первых браузеров, в отношении того, какую информацию они могут распознать на сайте. Как и ранние браузеры, роботы попросту не могут делать определенные вещи. Роботы не понимают фреймов, Flash анимаций, изображений или JavaScript. Они не могут зайти в разделы, защищенные паролем и не могут нажимать на все те кнопочки, которые есть на сайте.

Как работают роботы поисковой машины?

Поисковые роботы стоит воспринимать, как программы автоматизированного получения данных, путешествующие по сети в поисках информации и ссылок на информацию.

Когда, зайдя на страницу «Submit a URL», вы регистрируете очередную web-страницу в поисковике — в очередь для просмотра сайтов роботом добавляется новый URL. Даже если вы не регистрируете страницу, множество роботов найдет ваш сайт, поскольку существуют ссылки из других сайтов, ссылающиеся на ваш. Вот одна из причин, почему важно строить ссылочную популярность и размещать ссылки на других тематических ресурсах.

Придя на ваш сайт, роботы сначала проверяют, есть ли файл robots.txt. Этот файл сообщает роботам, какие разделы вашего сайта не подлежат индексации. Обычно это могут быть директории, содержащие файлы, которыми робот не интересуется или ему не следовало бы знать.

Роботы хранят и собирают ссылки с каждой страницы, которую они посещают, а позже проходят по этим ссылкам на другие страницы. Вся всемирная сеть построена из ссылок. Начальная идея создания Интернет сети была в том, что бы была возможность перемещаться по ссылкам от одного места к другому. Вот так перемещаются и роботы.

Будучи внедрена в базу данных поисковой машины, информация доступна пользователям, которые осуществляют поиск. Когда пользователь поисковой машины вводит поисковый запрос, производится ряд быстрых вычислений для уверенности в том, что выдается действительно правильный набор сайтов для наиболее релевантного ответа.

Вы можете просмотреть, какие страницы вашего сайта уже посетил поисковый робот, руководствуясь лог-файлами сервера, или результатами статистической обработки лог-файла. Идентифицируя роботов, вы увидите, когда они посетили ваш сайт, какие страницы и как часто. Некоторые роботы легко идентифицируются по своим именам, как Google’s «Googlebot». Другие более скрытые, как, например, Inktomi’s «Slurp». Другие роботы так же могут встречаться в логах и не исключено, что вы не сможете сразу их идентифицировать; некоторые из них могут даже оказаться браузерами, которыми управляют люди.

Помимо идентификации уникальных поисковых роботов и подсчета количества их визитов, статистика также может показать вам агрессивных, поглощающих ширину катала пропускания роботов или роботов, нежелательных для посещения вашего сайта.

Как они читают страницы вашего web-сайта?

Когда поисковый робот посещает страницу, он просматривает ее видимый текст, содержание различных тегов в исходном коде вашей страницы (title tag, meta tags, и т.д.), а так же гиперссылки на странице. Судя по словам ссылок, поисковая машина решает, о чем страница. Есть много факторов, используемых для вычисления ключевых моментов страницы. Каждая поисковая машина имеет свой собственный алгоритм для оценки и обработки информации. В зависимости от того, как робот настроен, информация индексируется, а затем доставляется в базу данных поисковой системы.

После этого, информация, доставленная в индексные базы данных поисковой системы, становится частью поисковика и процесса ранжирования в базе. Когда посетитель осуществляет запрос, поисковик просматривает всю базу данных для выдачи конечного списка, релевантного поисковому запросу.

Базы данных поисковых систем подвергаются тщательной обработке и приведению в соответствие. Если вы уже попали в базу данных, роботы будут навещать вас периодически для сбора любых изменений на страницах и уверенности в том, что обладают самой последней информацией. Количество посещений зависит от установок поисковой машины, которые могут варьироваться от ее вида и назначения.

Иногда поисковые роботы не в состоянии проиндексировать web-сайт. Если ваш сайт упал или на сайт идет большое количество посетителей, робот может быть бессилен в попытках его индексации. Когда такое происходит, сайт не может быть переиндексирован, что зависит от частоты его посещения роботом. В большинстве случаев, роботы, которые не смогли достичь ваших страниц, попытаются позже, в надежде на то, что ваш сайт в ближайшее время будет доступен.

.jpg/200px-%D0%A1%D0%BA%D1%80%D0%B8%D0%BD%D1%88%D0%BE%D1%82_1_(24).jpg)

.jpg/200px-%D0%A1%D0%BA%D1%80%D0%B8%D0%BD%D1%88%D0%BE%D1%82_2_(17).jpg)

.jpg/200px-%D0%A1%D0%BA%D1%80%D0%B8%D0%BD%D1%88%D0%BE%D1%82_3_(13).jpg)